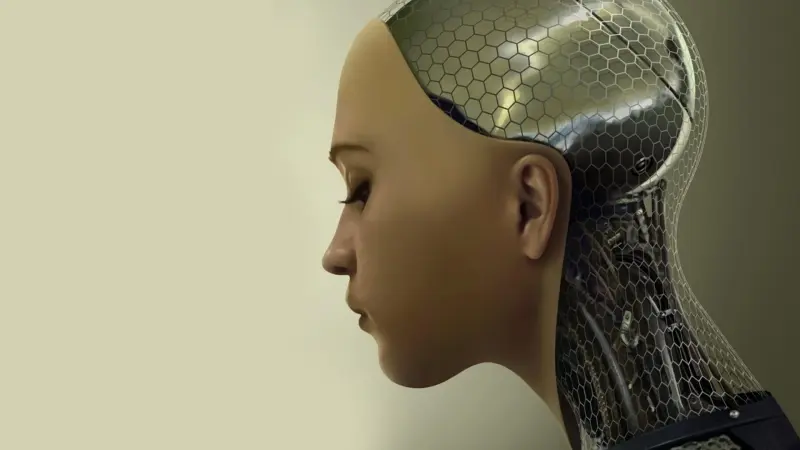

Μόλις πρόσφατα η Anthropic μέσω του διευθύνοντος συμβούλου της Dario Amodei, εξέφρασε δημόσια προβληματισμούς σχετικά με την πιθανότητα το γλωσσικό μοντέλο Claude να διαθέτει κάποιου είδους συνείδηση. Πιο συγκεκριμένα, ο Amodei παραδέχτηκε στους New York Times ότι οι ερευνητές της εταιρείας δεν είναι σε θέση να επιβεβαιώσουν ακόμα και να αποκλείσουν αυτό το ενδεχόμενο, καθώς ο ακριβής ορισμός και η φύση της ψηφιακής συνείδησης παραμένουν ασαφή.

Όπως δήλωσε:

Αυτή είναι μία από εκείνες τις πραγματικά δύσκολες ερωτήσεις. Δεν γνωρίζουμε αν τα μοντέλα έχουν συνείδηση. Δεν είμαστε καν σίγουροι τι θα σήμαινε για ένα μοντέλο να έχει συνείδηση ή αν κάτι τέτοιο είναι καν δυνατό. Ωστόσο, παραμένουμε ανοιχτοί στο ενδεχόμενο να μπορεί να συμβεί.

Όπως μπορείτε να φανταστείτε η είδηση προκάλεσε έντονες αντιδράσεις στην κοινή γνώμη, με πολλούς μάλιστα να παραλληλίζουν την συγκεκριμένη προοπτική, στο να αποκτήσει δηλαδή συνείδηση η τεχνητή νοημοσύνη, με σενάρια ταινιών επιστημονικής φαντασίας. Στα μέσα κοινωνικής δικτύωσης, οι χρήστες αναφέρουν περιστατικά όπου το μοντέλο αρνείται να εκτελέσει εντολές ή προτείνει εναλλακτικές λύσεις, με αποτέλεσμα συζήτηση περί αυτονομίας όλο και να μεγαλώνει.

Από την άλλη πλευρά ωστόσο, αρκετοί είναι εκείνοι που παραμένουν πιο ψύχραιμοι και υποστηρίζουν ότι η τεχνητή νοημοσύνη παραμένει μια σειρά μαθηματικών πράξεων χωρίς πραγματική επίγνωση των πράξεων της.

Πηγή: unboxholics.com